Actualidad informática

Noticias y novedades sobre informática

Físicos acaban de encontrar un resquicio en el grafeno que podría desbloquear una energía limpia e ilimitada

Con todas las medidas, el grafeno no debería existir. El hecho es que se reduce a un claro vacío en la física que ve una lámina 2D imposible, de átomos actuar como un material 3D sólido.

Nuevas investigaciones han profundizado en el ondulamiento del grafeno, descubriendo un fenómeno físico a escala atómica que podría ser explotado como una forma de producir un suministro virtualmente ilimitado de energía limpia.

El equipo de físicos liderado por investigadores de la Universidad de Arkansas (EE.UU.) no se propuso descubrir una nueva forma radical de alimentar dispositivos electrónicos. Su objetivo era mucho más humilde: simplemente observar cómo se mueve el grafeno.

Todos estamos familiarizados con el material negro arenoso a base de carbón llamado grafito, que comúnmente se combina con un material cerámico para hacer la llamada’ mina’ en lápices. Lo que vemos como manchas dejadas por el lápiz son en realidad hojas apiladas de átomos de carbono dispuestas en un patrón de «alambre de gallina». Como estas hojas no están unidas entre sí, se deslizan fácilmente unas sobre otras.

Durante años, los científicos se preguntaron si era posible aislar láminas individuales de grafito, dejando que un plano bidimensional de’ malla metálica’ de carbono permaneciera por sí solo.

En 2004, un par de físicos de la Universidad de Manchester lograron lo imposible, aislando las hojas de un trozo de grafito que era sólo un átomo de grosor. Para existir, el material 2D tenía que ser tramposo de alguna manera, actuando como un material 3D para proporcionar algún nivel de robustez.

Resulta que la «laguna» era el movimiento aleatorio de átomos que saltaban de un lado a otro, dando a la hoja 2D de grafeno una práctica tercera dimensión. En otras palabras, el grafeno era posible porque no era perfectamente plano en absoluto, sino que vibraba a nivel atómico de tal manera que sus enlaces no se desentrañaban espontáneamente.

Para medir con precisión el nivel de esta confusión, el físico Paul Thibado lideró recientemente un equipo de estudiantes graduados en un simple estudio. Pusieron láminas de grafeno a través de una rejilla de cobre de apoyo y observaron los cambios en las posiciones de los átomos usando un microscopio de barrido de túnel.

Mientras que podían registrar el balanceo de los átomos en el grafeno, los números no encajaban realmente en ningún modelo esperado. No pudieron reproducir los datos que estaban recopilando de un ensayo a otro. «Los estudiantes sentían que no íbamos a aprender nada útil», dice Thibado,»pero me preguntaba si estábamos haciendo una pregunta demasiado simple».

Thibado impulsó el experimento en una dirección diferente, buscando un patrón cambiando la forma en que miraban los datos. «Separamos cada imagen en subimágenes», dice Thibado. «Mirando los promedios a gran escala se ocultaron los diferentes patrones. Cada región de una sola imagen, cuando se veía en el tiempo, producía un patrón más significativo.»

El equipo rápidamente descubrió que las hojas de grafeno se doblaban de una manera no muy diferente a como se doblaban hacia adelante y hacia atrás de una pieza doblada de metal delgado mientras se retorcía por los lados.

Los patrones de pequeñas fluctuaciones aleatorias que se combinan para formar cambios repentinos y dramáticos se conocen como vuelos de Lévy. Si bien han sido observados en sistemas complejos de biología y clima, esta fue la primera vez que fueron vistos a escala atómica.

Al medir la velocidad y escala de estas ondas de grafeno, Thibado pensó que podría ser posible utilizarlas como fuente de energía a temperatura ambiente. Mientras la temperatura del grafeno permitiera que los átomos se movieran incómodamente, continuaría ondulando y doblándose.

Coloque los electrodos a cada lado de las secciones de este grafeno pandeo, y usted tendría un pequeño cambio de voltaje.

Según los cálculos de Thibado, un solo trozo de grafeno de diez micrones por diez micrones podría producir diez microwatios de potencia. Puede que no suene impresionante, pero dado que podría caber más de 20000 de estos cuadrados en la cabeza de un alfiler, una pequeña cantidad de grafeno a temperatura ambiente podría, posiblemente, alimentar algo pequeño como un reloj de pulsera indefinidamente. Mejor aún, podría alimentar bioimplantes que no necesiten baterías incómodas.

Por muy emocionantes que sean, estas aplicaciones todavía necesitan ser investigadas. Afortunadamente Thibado ya está trabajando con científicos del Laboratorio Naval de Investigación de los Estados Unidos para ver si el concepto tiene potencial.

Para una molécula imposible, el grafeno se ha convertido en algo así como un material maravilloso que ha girado la física en su cabeza.

Ya está siendo promocionado como un bloque de construcción para futuros conductores. Tal vez también veamos que también va a impulsar el futuro de un nuevo campo de dispositivos electrónicos.

Esta investigación fue publicada en Physical Review Letters.

Material ‘magnetoeléctrico’ promete ser una memoria para la electrónica

Los teléfonos inteligentes y los ordenadores no serían tan útiles sin espacio para muchas aplicaciones, música y vídeos. Los dispositivos tienden a almacenar esa información de dos maneras: a través de los campos eléctricos (piensa en una unidad flash) o a través de los campos magnéticos (como el disco duro del ordenador). Cada método tiene ventajas y desventajas. Sin embargo, en el futuro, nuestra electrónica podría beneficiarse de lo mejor de cada uno.

«Hay un concepto interesante», dice Chang-Beom Eom, profesor de Theodore H. Geballe y Harvey D. Spangler, profesor distinguido de Ciencia e Ingeniería de Materiales en la Universidad de Wisconsin-Madison. «¿Pueden acoplarse estas dos formas diferentes de almacenar información? ¿Podríamos usar un campo eléctrico para cambiar las propiedades magnéticas? Entonces usted puede tener un dispositivo multifuncional de baja potencia. Llamamos a esto un dispositivo ‘magnetoeléctrico'».

En una investigación publicada recientemente en la revista Nature Communications, Eom y sus colaboradores describen no sólo su proceso único para hacer un material magnetoeléctrico de alta calidad, sino también cómo y por qué funciona.

Los materiales magnetoeléctricos — que tienen funcionalidades magnéticas y eléctricas — ya existen. La conmutación de una funcionalidad induce un cambio en la otra. «Se llama cross-coupling», dice Eom. «Sin embargo, cómo se cruzan no se entiende claramente.»

Obtener esa comprensión, dice, requiere estudiar cómo cambian las propiedades magnéticas cuando se aplica un campo eléctrico. Hasta ahora, esto ha sido difícil debido a la complicada estructura de la mayoría de los materiales magnetoeléctricos.

En el pasado, dice Eom, la gente estudiaba las propiedades magnetoeléctricas usando materiales muy «complejos», o aquellos que carecen de uniformidad. En su enfoque, Eom simplificó no sólo la investigación, sino también el propio material.

Aprovechando su experiencia en el desarrollo de materiales, desarrolló un proceso único, utilizando «pasos» atómicos, para guiar el crecimiento de una fina película homogénea y monocristalina de ferrita de bismuto. Encima de eso, agregó cobalto, que es magnético; en el fondo, colocó un electrodo hecho de rutenato de estroncio.

El material de ferrita bismuto fue importante porque facilitó mucho el estudio del acoplamiento cruzado magnetoeléctrico fundamental por parte de Eom.

«Nos dimos cuenta de que en nuestro trabajo, debido a nuestro dominio único, podíamos ver lo que estaba ocurriendo utilizando múltiples sondeos o técnicas de imágenes», dice. «El mecanismo es intrínseco. Es reproducible, y eso significa que puedes hacer un dispositivo sin degradación alguna, de forma predecible».

Para visualizar el cambio de las propiedades eléctricas y magnéticas en tiempo real, Eom y sus colegas utilizaron las potentes fuentes de luz sincrotrón en el Argonne National Laboratory de Chicago, así como en Suiza y el Reino Unido.

«Cuando lo cambias, el campo eléctrico cambia la polarización eléctrica. Si está hacia abajo, cambia hacia arriba», dice. «El acoplamiento a la capa magnética cambia sus propiedades: un dispositivo de almacenamiento magnetoeléctrico.»

Ese cambio de dirección permite a los investigadores dar los siguientes pasos necesarios para añadir al material circuitos integrados programables, los componentes básicos que constituyen la base de nuestra electrónica.

Aunque el material homogéneo permitió a Eom responder a importantes preguntas científicas sobre cómo se produce el acoplamiento cruzado magnetoeléctrico, también podría permitir a los fabricantes mejorar su electrónica. «Ahora podemos diseñar un dispositivo mucho más eficaz, eficiente y de baja potencia», afirma.

_________________

El equipo de Eom incluye tanto teóricos como experimentalistas, incluyendo al profesor de física Mark Rzchowski, profesor de la Universidad de Madison y colaboradores en Diamond Light Source en Inglaterra, Temple University, la Universidad de Oxford, el Laboratorio Nacional Argonne, Swiss Light Source, el Instituto de Ciencia y Tecnología de Luxemburgo y la Universidad de Northern Illinois.

Este trabajo fue apoyado por la Oficina de Investigación del Ejército (W911NF-10-1-0362 y W911NF-13-1-0486) y el Departamento de Energía (DE-FG02-03ER46097 y DE-AC02-06CH11357).

Renee Meiller, (608)262-2481, meiller@engr.wisc.edu

3.5 GHz será la banda preponderante en 5G

Para abordar el potencial de 5G, la industria inalámbrica está estudiando una amplia gama de frecuencias de espectro radioeléctrico desde sub-1-GHz hasta 100 GHz, incluyendo espectro licenciado, sin licencia y compartido. Sin embargo, según los nuevos hallazgos de ABI Research, mientras que el uso de la tecnología mmWave (ondas milimétricas, banda de espectro entre 30 gigahertz (Ghz) y 300 Ghz) es una de las características más distintivas de 5G, a corto plazo la banda C está emergiendo con el consenso más global para el lanzamiento oportuno de la red comercial 5G en 2019.

A pesar de que muchos de los ensayos 5G de laboratorio y de campo realizados por participantes de la industria se han enfocado en frecuencias más altas, los recientes anuncios regulatorios de unos 20 países han apuntado a la banda C como el rango de espectro más común identificado para 5G.

«A largo plazo, toda la amplitud de la gama de espectro de sub-1-GHz a 100 GHz será crítica para abordar los diversos casos de uso y cumplir con velocidades mejoradas, latencia, fiabilidad y otras métricas 5G en diferentes escenarios de uso. A corto plazo, sin embargo, la utilización de ondas milimétricas para los servicios 5G en 2019-2020 se ve limitada debido a los desafíos tecnológicos y a la disponibilidad de espectro global», explica Prayerna Raina, Analista Senior de ABI Research.

Dado que la comunicación celular actual tiene lugar por debajo de 6 GHz, el uso de gamas de frecuencias más altas para la banda ancha móvil no es un territorio familiar para los operadores móviles. De manera similar, tecnologías clave de antenas 5G y estaciones base como MIMO se encuentran actualmente desplegadas en el rango por debajo de 6 GHz en un nivel bajo de cuatro a 16 elementos de antena en la mayoría de los casos. En frecuencias de ondas mmWave más altas, es probable que las antenas MIMO masivas tengan cientos de elementos de antena, lo que trae consigo su propio conjunto de desafíos.

El uso de frecuencias más altas, como 26 GHz y 28 GHz para el servicio fijo de banda ancha móvil en redes 5G es seguro, pero es la banda C con su armonización global la que está creando oportunidades para el despliegue a gran escala.

«En última instancia, 5G debe tener un buen sentido comercial para los operadores que siguen luchando contra el estancamiento de los ARPU, el aumento del tráfico de red y la necesidad de optimizar la gestión y las operaciones de red de forma rentable», afirma Raina. «La banda C, con el apoyo de las nuevas tecnologías, incluido el desacoplamiento de enlaces ascendentes, será probablemente la banda espectral dominante de 5G, ya que permite a los operadores desplegar 5G en una red existente, en lugar de gastar significativamente en nuevas instalaciones celulares», concluye Raina.

Ampliar en: MWee

Un material con propiedades prometedoras

El Collaborative Research Center CRC 1214 de la Universidad de Konstanz ha desarrollado un método para sintetizar nanopartículas de óxido de europio (II), un semiconductor ferromagnético que es relevante para el almacenamiento y transporte de datos.

Los semiconductores ferromagnéticos han atraído una atención creciente en la última década. Sus propiedades los convierten en materiales funcionales prometedores que se pueden utilizar en el campo de la electrónica basada en espín (espintrónica). La espintrónica es de crucial importancia para el almacenamiento y transporte de información. En una colaboración interdisciplinaria, los investigadores de la Universidad de Konstanz desarrollaron con éxito un método para sintetizar nanopartículas de óxido de europio (II) (EuO), un semiconductor ferromagnético con propiedades extremadamente prometedoras. Los investigadores también demostraron que las nanopartículas tienen propiedades magnéticas debido a su estructura. Los resultados del proyecto de investigación conjunta se han publicado en la edición del 20 de noviembre de 2017 de la revista científica Advanced Materials .

La colaboración de los grupos de investigación dirigidos por el profesor Sebastián Polarz (química inorgánica), el profesor Mikhail Fonin (física experimental) y el profesor Ulrich Nowak (física teórica) de la Universidad de Konstanz, así como el equipo de microscopía electrónica del Instituto Leibniz para Solid State and Materials Research Dresden (IFW Dresden), dirigido por el Dr. Axel Lubk, se llevó a cabo en el marco del Centro de Colaboración de la Universidad de Konstanz (SFB) «Partículas anisotrópicas como bloques de construcción: Adaptación de la forma, interacciones y estructuras». «Sin la cooperación de estos equipos de investigación, no podríamos haber logrado estos resultados», dice Bastian Trepka, autor principal del estudio y miembro del equipo de investigación de Sebastian Polarz Functional Inorganic Materials, donde se han sintetizado las nanopartículas.

Las propiedades de las nanopartículas anisotrópicas y magnéticas están en el centro del proyecto de investigación A5 del SFB. Anisotrópico significa que la forma y las propiedades magnéticas, ópticas o electrónicas no son idénticas para todas las direcciones espaciales de la partícula. Esto, a su vez, permite investigar no solo las propiedades nuevas y a menudo mejoradas de los materiales nanoestructurados, sino también las propiedades adicionales causadas por la anisotropía.

La producción de nanopartículas a partir de semiconductores ferromagnéticos como el óxido de europio (II) constituye un gran desafío, especialmente en la geometría anisotrópica. Después de todo, las partículas con las nuevas propiedades interesantes esperadas también deben ser anisotrópicas. «El objetivo es profundizar nuestra comprensión para que podamos modular y acceder a las propiedades de los nanosistemas bajo demanda», dice el autor principal, Trepka. Usando su método especial, los investigadores lograron producir nanopartículas de EuO de alta calidad y anisotrópicas que pueden usarse para observar los efectos de la estructura de la propiedad.

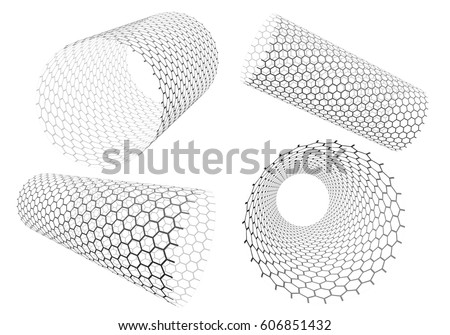

El método se basa en un proceso de dos etapas. En un primer paso, se produce un material híbrido que consta de componentes orgánicos e inorgánicos, que ya es anisotrópico. En el siguiente paso, el material híbrido se trata con vapor de europio. Como resultado, se convierte químicamente en EuO. En este caso, la forma de las nanopartículas es tubular. «Este método es interesante porque no se limita a formas tubulares. También es posible producir varillas», explica Bastian Trepka.

Además, los investigadores pudieron demostrar que las propiedades magnéticas del semiconductor óxido de Europio (II) están realmente relacionadas con la forma de su nanoestructura, o más bien la anisotropía. Después de un tratamiento adicional al intentar generar contra evidencia, las formas tubulares desaparecieron, dando como resultado diferentes propiedades. «Los físicos experimentales llevaron a cabo mediciones que confirmaron los resultados que habían sido simulados por los físicos teóricos. Esto nos permitió desarrollar ideas sobre cómo la estructura produce este comportamiento magnético particular», explica Bastian Trepka.

«Lo que es realmente especial acerca de nuestro proceso es la separación del control de la estructura y la transformación química. Podemos obtener diferentes formas del mismo material influyendo en la forma a través del control del proceso. De esta forma siempre conseguiremos que el material adopte la forma que necesitamos» , dice Trepka. En el caso del óxido de europio (II), se trata de una nanotransformación topotáctica que mantiene su dirección cristalina: es tubular tanto antes como después del tratamiento.

«Un material inteligente con una variedad de propiedades», dice Bastian Trepka de Europium (II) oxide. Sobre todo, tiene una estructura cristalina simple. «Podemos explicar los cambios en las propiedades que apelan a las estructuras cristalinas, que están predeterminadas». Esto es ideal para la investigación básica.

Ampliar en: https://doi.org/10.1002/adma.201703612

¿Cuál es la potencia computacional del universo?

¿Puede una mirada cercana al universo darnos soluciones a problemas demasiado difíciles de resolver, incluso para una computadora del tamaño de un planeta?

Ampliar en: PHYS.ORG

Los nanotubos de carbono causan cáncer de la misma manera que el asbesto

Los nanotubos de carbono son cancerígenos y el mecanismo por el cual causan cáncer parecería ser el mismo que en el caso del amianto, según un artículo publicado en Current Biology por autores del Medical Research Council (MRC) del Reino Unido.

Los nanotubos de carbono (CNTs) son un material maravilloso muy anunciado, más fuerte que el acero y un conductor eléctrico superior debido a su naturaleza bidimensional enrollada. Sin embargo, la naturaleza cancerígena de las fibras largas de CNT indica cautela en cómo se usan, concluyen los investigadores.

Se están desplegando y experimentando en múltiples áreas de la nanoelectrónica. Sin embargo, los CNT deben manejarse con cuidado. Su naturaleza nanoscópica los hace difíciles de controlar y dificulta asimismo la protección de los agentes de producción. Las mismas lecciones probablemente deberían trasladarse al uso de muchos de los denominados materiales biopersistentes en la escala de nanómetros.

Uno de los grandes problemas con el asbesto en el pasado, y con los CNTs ahora, es que su naturaleza inducida por el cáncer es un efecto a largo plazo. Una vez que se toman en las fibras son difíciles de purgar y permanecen inadvertidas en los pulmones. Es el efecto inflamatorio a largo plazo de las fibras largas atraídas a los pulmones lo que abre las vías químicas y bioquímicas al cáncer, aunque los mecanismos moleculares que subyacen al mesotelioma de latencia larga aún no se conocen.

La investigación del MRC muestra que las fibras largas biopersistentes inducen la enfermedad pleural, incluyendo el mesotelioma, en la misma vía que el asbesto. Los investigadores afirman:»Dado que la creciente fabricación de fibras largas de CNT aumenta el potencial de exposición humana, nuestros hallazgos refuerzan la necesidad de precaución al usar estos agentes si se quiere evitar el daño a largo plazo».

Ampliar en: eeNews

La Curveball de 56 cubits de IBM puede afectar a los planes de computación cuántica de Google

Justo cuando parecía subestimada, la computación clásica está volviendo a atacar. IBM ha ideado una manera de simular ordenadores cuánticos que tienen 56 bits cuánticos, o cubits, en un superordenador no cuántico – una tarea que antes se creía imposible. La hazaña mueve los palos de la portería en la lucha por la supremacía cuántica, el esfuerzo por superar a las computadoras clásicas usando las cuánticas.

Justo cuando parecía subestimada, la computación clásica está volviendo a atacar. IBM ha ideado una manera de simular ordenadores cuánticos que tienen 56 bits cuánticos, o cubits, en un superordenador no cuántico – una tarea que antes se creía imposible. La hazaña mueve los palos de la portería en la lucha por la supremacía cuántica, el esfuerzo por superar a las computadoras clásicas usando las cuánticas.

Antes se aceptaba ampliamente que un ordenador clásico no puede simular más de 49 qubits debido a limitaciones de memoria. La memoria necesaria para las simulaciones aumenta exponencialmente con cada cubit adicional.

Lo más cerca que se había llegado a poner a prueba el límite de 49 bits era una simulación de 45 bits en el Instituto Federal Suizo de Tecnología de Zúrich, que necesitaba 500 terabytes de memoria. La nueva simulación de IBM eleva la suposición al simular 56 qubits con sólo 4,5 terabytes.

La simulación se basa en un truco matemático que permite una representación numérica más compacta de los diferentes arreglos de qubits, conocidos como estados cuánticos.

Una operación de computación cuántica es típicamente representada por una tabla de números que indica lo que se debe hacer a cada cubit para producir un nuevo estado cuántico. En su lugar, los investigadores del Centro de Investigación T. J. Watson de IBM en Yorktown Heights, Nueva York, utilizaron tensores – tablas efectivamente multidimensionales aumentadas con ejes más allá de filas y columnas.

Gracias a los ejes adicionales, se puede introducir mucha más información en unos cuantos tensores, siempre y cuando sepamos escribirla en el lenguaje de los tensores. Los investigadores encontraron una forma de hacer precisamente eso para las operaciones de computación cuántica.

Vergonzosamente paralelos

Al escribir las operaciones en forma tensorial, también descubrieron una manera de dividir la tarea de simulación en lo que ellos llaman trozos «vergonzosamente paralelos», lo que les permitió usar los muchos procesadores de un supercomputador simultáneamente. Esto les ganó el último bit de eficiencia necesario para simular una computadora cuántica de 56 bits.

IBM se ha pasado de la raya «, dice Itay Hen de la Universidad del Sur de California. «Será mucho más difícil para la gente de dispositivos cuánticos exhibir supremacía.»

IBM tiene ahora un ordenador cuántico funcional de 56 bits que vive en su supercomputadora. Pero mientras que eso es una mejora con respecto al récord anterior, Andrew Childs en la Universidad de Maryland dice que no es un gran salto hacia adelante. No creo que estén afirmando que esto vaya a darles una simulación eficiente de sistemas cuánticos en un ordenador clásico «, dice.

Aun así, han subido la apuesta en la carrera por superar a los ordenadores clásicos con sistemas cuánticos. Google dijo anteriormente que estaban en camino de construir un procesador de 49 bits a finales de 2017, pero eso ya no les permitirá alcanzar la supremacía cuántica.

De hecho, Bob Wisnieff, el investigador principal del estudio de IBM, dice que su simulación actual funciona cerca de «mil millones de veces más lento» que las estimaciones teóricas para una computadora cuántica real de 56 cubits.

El equipo de Wisnieff planea experimentar con supercomputadoras cuyos procesadores pueden comunicarse eficazmente entre sí. Esperan poder exprimir unos cuantos más de estos canales de comunicación, lo que ayuda a acelerar el cálculo paralelo necesario para la simulación.

El objetivo de IBM es construir una computadora cuántica que pueda «explorar problemas prácticos» como la química cuántica, dice Wisnieff. Espera comprobar la precisión de las computadoras cuánticas frente a sus simulaciones antes de poner a prueba las computadoras cuánticas reales.

«Quiero ser capaz de escribir algoritmos para los que conozco las respuestas antes de ejecutarlos en una computadora cuántica real «, dice.

Referencia: arxiv.org/abs/1710.05867

La guía del fabricante de medicamentos para la galaxia

En 2016, la empresa farmacéutica Sunovion asignó a un grupo de profesionales experimentados una misión inusual. En la sede central de la firma en Marlborough, Massachusetts, a todos los químicos se les pidió que participaran en un juego para ver quién podía descubrir las mejores pistas de medicamentos nuevos. En sus puestos de trabajo había una cuadrícula de cientos de estructuras químicas, de las cuales sólo diez estaban etiquetadas con información sobre sus efectos biológicos. Los expertos tuvieron que seleccionar otras moléculas que podrían resultar ser candidatas a medicamentos, utilizando sus conocimientos de estructura química y biología, que tanto les costó aprender. De los 11 jugadores, 10 lucharon durante varias horas. Pero uno de ellos consiguió pasar en milisegundos, porque era un algoritmo.

Ese programa de computación fue la creación de Willem van Hoorn, jefe de quimioinformática de Exscientia, una empresa que usa inteligencia artificial (IA) para diseñar medicamentos. La firma, con sede en Dundee, Reino Unido, quería ampliar una incipiente asociación con Sunovion, por lo que las apuestas eran altas. «Mi credibilidad estaba en juego», dice van Hoorn. Veinte rondas de juego más tarde, él anotó los puntos. El alivio lo invadió. Su algoritmo había dominado al menos algunas de las artes oscuras de la química; sólo un experto en caza de drogas había derrotado a la máquina.

Desde entonces, Exscientia y Sunovion han seguido trabajando juntas para descubrir fármacos psiquiátricos. «Esta competencia realmente ayudó a que la gente que toma las decisiones de investigación química se comprometiera», dice Scott Brown, director de química computacional de Sunovion.

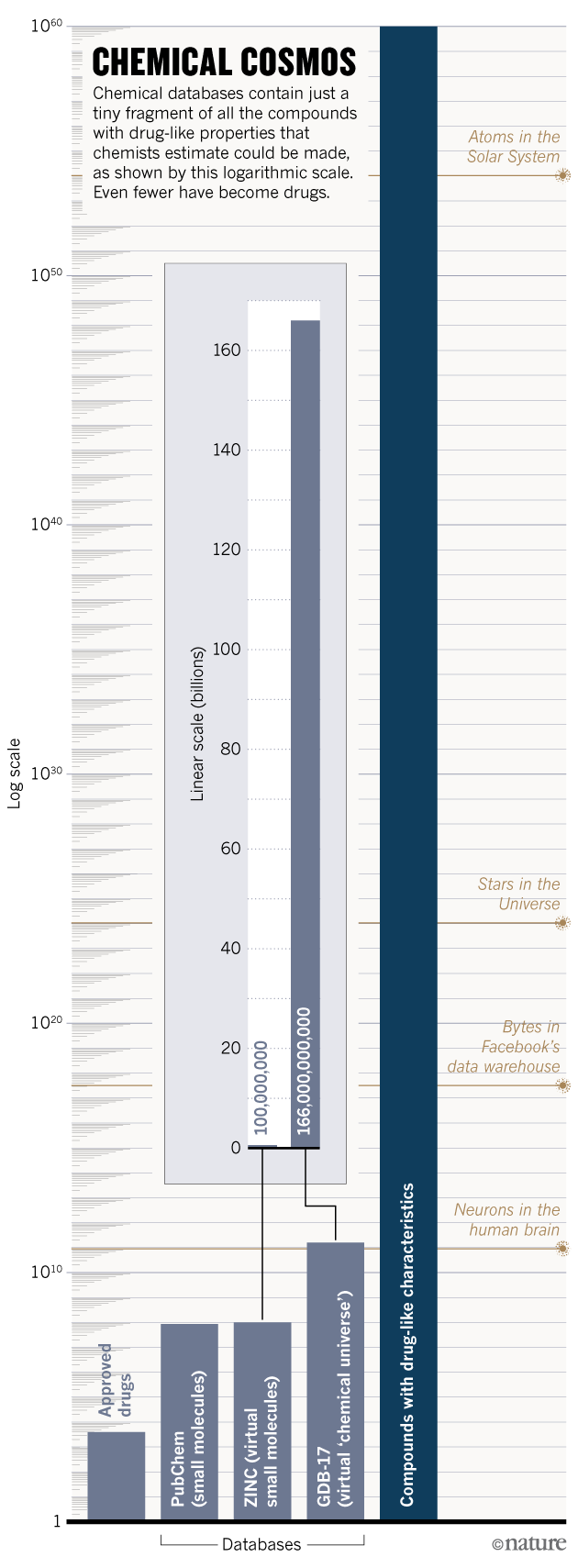

Exscientia es sólo uno de los numerosos grupos de la industria y el mundo académico que están recurriendo a las computadoras para explorar el asombroso y gran universo químico. Los químicos estiman que se podrían hacer 10^60 compuestos con características parecidas a las de un fármaco, es decir, moléculas más pequeñas que átomos hay en el Sistema Solar. La esperanza es que los algoritmos catalogarán, caracterizarán y compararán las propiedades de millones de compuestos para ayudar a los investigadores a encontrar rápidamente y de manera asequible los mejores candidatos para un objetivo. Los defensores argumentan que estas estrategias podrían hacer que los medicamentos sean más seguros, asegurar que menos medicamentos fallen en los ensayos clínicos y permitir el descubrimiento de nuevas clases de terapias. También podrían ayudar a abrir áreas de espacio químico que quedan inexploradas o supuestamente estériles.

Pero muchos químicos medicinales se muestran escépticos ante la exageración, no convencidos de que la inefable complejidad de la química pueda reducirse a simples líneas de código. Incluso los defensores de la IA reconocen que muchos intentos han fracasado: los compuestos generados por computadora pueden estar plagados de componentes difíciles de fabricar, como los anillos de 3 o 4 átomos, e infestados con grupos reactivos que activan las alarmas de seguridad. «La ejecución de algunos enfoques computacionales puede sufrir mucho cuando los investigadores simplemente no conocen el campo», dice van Hoorn. «Los compuestos que se les ocurren son simplemente ridículos», pero afirma que un toque humano experto podría domar a estos diseñadores digitales demasiado entusiastas. «Creo que algunas de estas ideas podrían funcionar si los informáticos colaboraran con gente que realmente respira química.»

Exploración espacial

Para navegar por el universo químico, ayuda tener un mapa. En 2001, el químico Jean-Louis Reymond, de la Universidad de Berna (Suiza), comenzó a utilizar ordenadores para trazar la mayor parte del espacio masivo posible. Dieciséis años después, ha acumulado la mayor base de datos de moléculas pequeñas del mundo, una gigantesca colección virtual de 166 mil millones de compuestos. La base de datos, llamada GDB-17, incluye todas las moléculas orgánicas químicamente factibles, compuestas de hasta 17 átomos, tantas como los ordenadores de Reymond puedan soportar. Sólo para que un ordenador pueda compilar una lista de los compuestos de la base de datos llevaría ahora más de 10 horas», dice Reymond.

Para dar sentido a esta plétora de posibles puntos de partida de medicamentos, Reymond ha ideado una forma de organizar su universo químico. Inspirándose en la tabla periódica, ha agrupado los compuestos en un espacio multidimensional en el que los compuestos vecinos tienen propiedades relacionadas. Las posiciones se asignan de acuerdo a 42 características, tales como cuántos átomos de carbono tiene cada compuesto.

Por cada medicamento que ha llegado al mercado, hay millones de compuestos que son químicamente casi idénticos a él – solo que tienen un hidrógeno extra aquí o doble enlace allí. Y algunos de estos funcionarán mejor que el medicamento aprobado. Los químicos no podrían concebir todas estas variaciones sin ayuda. «No hay manera de llegar a estos isómeros usando un bolígrafo y un pedazo de papel», dice Reymond.

Pero Reymond y su equipo pueden identificar «vecinos cercanos» terapéuticamente prometedores de drogas probadas mediante la búsqueda de similitudes entre los compuestos. Al utilizar un medicamento en particular como punto de partida, el equipo puede peinar los 166 mil millones de compuestos en la base de datos para obtener candidatos de seguimiento convincentes en sólo 3 minutos. En un experimento de prueba de principio, Reymond comenzó con una molécula conocida que une el receptor de acetilcolina nicotínica, un objetivo útil para trastornos que involucran el sistema nervioso o la función muscular, y compiló una lista corta de 344 compuestos relacionados. El equipo sintetizó tres, y descubrió que dos podrían activar el receptor de forma potente, y podrían ser útiles para tratar la atrofia muscular en el envejecimiento. El enfoque es como usar un mapa geológico para determinar dónde buscar oro, dice Reymond. «Necesitas alguna forma de elegir dónde vas a cavar», dice.

Un enfoque alternativo utiliza las computadoras para buscar oro en muchos lugares sin preocuparse demasiado por la ubicación inicial. En términos de búsqueda de medicamentos, esto significa que se deben buscar en sílice grandes bibliotecas químicas para encontrar pequeñas moléculas que se unen a una proteína dada. Primero, los investigadores tienen que tomar una instantánea de una proteína usando cristalografía de rayos X para determinar la forma de su sitio de unión. Luego, usando algoritmos de acoplamiento molecular, los químicos computacionales pueden escarbar a través de colecciones de compuestos para encontrar los mejores ajustes para cualquier sitio dado.

A medida que la potencia de computación ha explotado, las capacidades de estos algoritmos han mejorado. Los químicos de la Universidad de California en San Francisco, encabezados por Brian Shoichet, mostraron el potencial de este enfoque en 2016 en la búsqueda de una nueva clase de analgésicos. El equipo revisó más de tres millones de compuestos comercialmente disponibles para encontrar candidatos que activaran selectivamente la señalización del receptor de opiáceos para aliviar el dolor sin alterar la vía de señalización de detención de opiáceos estrechamente relacionada, que se cree que está asociada con los efectos secundarios de los opiáceos, incluyendo una menor frecuencia respiratoria y estreñimiento. Los investigadores rápidamente redujeron una biblioteca masiva de compuestos a sólo 23 compuestos altamente clasificados para el seguimiento.

En el tubo de ensayo, siete de los candidatos tuvieron la actividad deseada. El desarrollo posterior convirtió a uno de estos en PZM21, un compuesto que actúa sobre el receptor de los opiáceos sin activar la beta-arrestina. La firma biotecnológica Epiodyne, con sede en San Francisco, California, y cofundada por Shoichet, está ahora tratando de desarrollar un analgésico más seguro basado en los hallazgos. Shoichet planea utilizar el mismo enfoque para encontrar compuestos que modulen otros receptores acoplados a la proteína G (GPCR), una familia de proteínas que representa aproximadamente el 40% de los objetivos de medicamentos.

Su equipo también está llevando a cabo experimentos similares con una nebulosa virtual de 100 millones de compuestos que nunca se han hecho antes, pero que debería ser fácil de sintetizar. Los desarrolladores de medicamentos industriales también están probando este enfoque: la firma biotecnológica Nimbus Therapeutics, con sede en Cambridge, Massachusetts, incorpora en sus pantallas de acoplamiento compuestos virtuales con características de sustancias químicas naturales que normalmente tienen que ser obtenidas laboriosamente de entornos naturales como el suelo. El jurado todavía no está claro si esto conducirá a los medicamentos, pero Don Nicholson, director ejecutivo de la compañía, dice que para al menos un programa de diseño de fármacos, «de aquí vienen todos nuestros éxitos».

Los resultados preliminares de este tipo de pruebas virtuales están sacudiendo uno de los supuestos básicos de Shoichet sobre el espacio químico: que sólo vale la pena mirar en regiones establecidas y ricas en medicamentos. Galaxias bien caracterizadas de moléculas están tan inundadas con compuestos biológicamente activos que algunos argumentan que es una pérdida de tiempo buscar en otro lugar. «A lo largo de mi carrera he creído esa línea de razonamiento. Tenía sentido, aunque no hubiera tanta evidencia que lo apoyara «, dice Shoichet. Pero los resultados inéditos de sus cribas de 100 millones de compuestos están avivando su interés en las regiones menos exploradas del espacio químico. «Empiezo a pensar que esas galaxias están llenas de oro.»

… …

Ampliar en: nature

Físicos encuentran que no estamos viviendo en una simulación por ordenador

Por si acaso has estado pensando en ello, ahora puedes relajarte. Un equipo de físicos teóricos de la Universidad de Oxford en el Reino Unido ha demostrado que la vida y la realidad no pueden ser meras simulaciones generadas por un ordenador extraterrestre masivo.

El hallazgo, inesperadamente definido, surgió del descubrimiento de un vínculo novedoso entre las anomalías gravitacionales y la complejidad computacional.

En un artículo publicado en la revista Science Advances, Zohar Ringel y Dmitry Kovrizhi demuestran que la construcción de una simulación computarizada de un fenómeno cuántico particular que ocurre en los metales es imposible – no sólo prácticamente, sino en principio.

Inicialmente, la pareja se propuso ver si era posible utilizar una técnica conocida como Monte Carlo cuántico para estudiar el efecto Hall cuántico, un fenómeno en los sistemas físicos que exhiben fuertes campos magnéticos y temperaturas muy bajas, y se manifiesta como una corriente de energía que atraviesa el gradiente de temperatura. El fenómeno indica una anomalía en la geometría espacial-tiempo subyacente.

Los métodos de Monte Carlo cuántico utilizan el muestreo aleatorio para analizar los problemas cuánticos de muchos cuerpos donde las ecuaciones involucradas no pueden ser resueltas directamente.

Ringel y Kovrizhi mostraron que los intentos de usar Monte Carlo cuántico para modelar sistemas que exhiben anomalías, como el efecto Hall cuántico, siempre serán inviables. Descubrieron que la complejidad de la simulación aumentaba exponencialmente con el número de partículas que se estaban simulando.

Si la complejidad creciera linealmente con el número de partículas que se están simulando, duplicar el número de partículas significaría duplicar la potencia de computación requerida. Sin embargo, si la complejidad crece en una escala exponencial -donde la cantidad de potencia de computación tiene que duplicarse cada vez que se agrega una sola partícula- entonces la tarea se vuelve rápidamente imposible.

Los investigadores calcularon que almacenar información sobre un par de cientos de electrones requeriría una memoria de computadora que físicamente requeriría más átomos de los que existen en el universo.

Los investigadores notan que hay un número de otras interacciones cuánticas conocidas para las que aún no se han encontrado algoritmos predictivos. Sugieren que para algunos de ellos, de hecho, puede que nunca se encuentren.

Y dado que la cantidad físicamente imposible de tareas informáticas necesarias para almacenar información para un solo miembro de este subconjunto, los temores de que podríamos estar viviendo inconscientemente en una vasta versión de La Matriz ahora se puede eliminar.

Geoffrey Hinton, el padre del aprendizaje profundo (deep learning)

La Inteligencia Artificial está de moda gracias al aprendizaje profundo (deep learning), las redes de neuronas artificiales multicapa entrenadas con un algoritmo de retropropagación (backprop). Mucha gente cree ver una revolución emergente en esta tecnología; sin embargo, casi nada ha cambiado desde que el padre del aprendizaje profundo, Geoffrey Hinton, junto a dos colegas, introdujera el algoritmo de retropropagación en 1986. No solo lo digo yo en mis charlas, también lo dice él mismo, quien ahora es el científico más citado en aprendizaje profundo con gran diferencia respecto al siguiente.

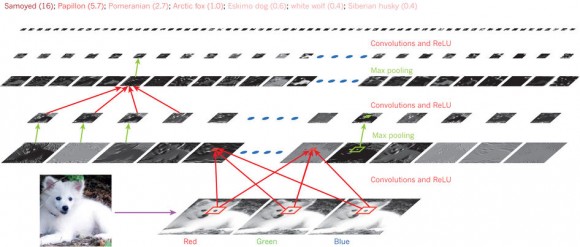

En 2012, Hinton y dos estudiantes demostraron que las redes de neuronas artificiales convolucionales podían reconocer imágenes con mayor precisión que cualquier otra técnica basada en inteligencia artificial. El secreto de estas redes era su número de neuronas por capa (la red tenía nueve capas): la primera capa tenía 150 528 neuronas (para recibir como entrada una imagen en color de 224 × 224 × 3 píxeles); tras aplicar 96 filtros de 11 × 11 × 3 se pasaba a la segunda capa con 253 440 neuronas; tras aplicar 256 filtros de 5 × 5 × 48 se pasaba a la tercera capa de 86 624 neuronas; tras 384 filtros de 3 × 3 × 256 se pasaba a la cuarta capa de 64 896 neuronas; tras aplicar 384 filtros de 3 × 3 × 192 se pasaba a la quinta capa de 64 896 neuronas; tras otros 256 filtros de 3 × 3 × 192 se pasaba a la sexta capa de 43 264 neuronas; finalmente, sin filtros, se encuentran tres capas de 4096, 4096, y 1000 neuronas. Esta última capa clasifica las imágenes de entrada en hasta 1000 clases diferentes.

Puede parecer que cambiar cientos o miles de neuronas por millones de neuronas es un cambio pequeño. Sin embargo, la potencia lograda con el cambio sorprendió a muchos, lo que llevó a Hinton a volver a publicar en Nature (no lo hacía desde 1986) y a que muchas empresas (Google, Apple, Facebook, etc.) se apuntasen al carro del aprendizaje profundo. Sin embargo, los grandes problemas de las redes de neuronas artificiales entrenadas con retropropagación no han sido resueltos aún. Entre ellos el problema del cuello de botella de la información (information bottleneck), descubierto en 1999.

El propio Hinton dice que “la mayoría de las conferencias sobre aprendizaje profundo solo presentan pequeñas variaciones de los algoritmos, sin plantearse problemas profundos sobre estos algoritmos”. En la inteligencia artificial hay más ingeniería que ciencia básica. Los avances futuros requieren una comprensión básica de cómo funcionan los sistemas de aprendizaje profundo y qué relación tienen con el funcionamiento de la mente humana.

Ampliar en: NAUKAS

autobus las palmas aeropuerto cetona de frambuesa